Uma revisão sistemática com meta-análise reuniu 27 estudos sobre sistemas de avaliação de habilidades apoiados por IA no ensino superior profissional e técnico e encontrou um efeito positivo moderado nos resultados de aprendizagem. Ao mesmo tempo, a evidência ainda é desigual: os trabalhos variam muito em tecnologia, desenho e métricas, o que limita conclusões mais firmes e reforça a necessidade de pesquisas mais robustas e de integração responsável, especialmente agora que a IA generativa começa a entrar no debate sobre avaliação.

O QUE HÁ DE NOVO: O artigo publicado em janeiro de 2026 na revista Information (MDPI) apresenta uma síntese quantitativa do impacto de sistemas de “AI-powered skill assessment” no ensino superior vocacional (Higher Vocational Education). Seguindo o protocolo PRISMA 2020, os autores rastrearam bases internacionais e chinesas (Web of Science, Scopus, ERIC e CNKI) e, de 1.246 registros iniciais, selecionaram 27 estudos empíricos revisados por pares, publicados entre 2010 e 2024, com dados suficientes para estimar tamanhos de efeito.

COMO FUNCIONA: A revisão se concentrou em intervenções que usam IA para medir desempenho em competências práticas e fornecer pontuação e/ou feedback, como laboratórios virtuais e simulações, ferramentas de visão computacional, sistemas tutores e análises de dados de aprendizagem. Para comparar resultados entre estudos com medidas diferentes, os autores converteram os achados em um indicador padronizado (Hedges’ g) e agregaram os efeitos por um modelo de efeitos aleatórios, que assume que o impacto real pode variar por contexto, tecnologia e desenho. O processo de extração de dados foi feito por dois codificadores, com checagem de concordância (kappa de 0,84 em 30% da amostra), e a heterogeneidade foi reportada com I², τ² e intervalo de predição.

PRINCIPAIS RESULTADOS: A meta-análise estimou um efeito combinado moderado a favor da avaliação apoiada por IA sobre resultados ligados a habilidades (g = 0,72; IC 95% 0,45–0,98; p < 0,001). A heterogeneidade foi classificada como moderada (I² = 39%; τ² = 0,024) e o intervalo de predição (0,15 a 1,20) sugere que novos estudos podem encontrar desde ganhos pequenos até ganhos grandes, dependendo de como a solução é implementada. Em análises por subgrupos, estudos na China mostraram efeito médio um pouco maior (g = 0,78) que os de Europa/América do Norte (g = 0,65), e áreas STEM e saúde tendem a apresentar ganhos mais fortes do que programas vocacionais mais orientados a humanidades.

POR QUE ISSO IMPORTA PARA A EDUCAÇÃO: Para cursos técnicos e profissionais, onde a aprendizagem é fortemente baseada em desempenho, a promessa central desses sistemas é tornar a avaliação mais escalável e consistente, com feedback mais rápido e dados mais finos sobre procedimentos, eficiência e precisão, algo difícil de sustentar apenas com observação humana e rubricas em turmas grandes. Se bem desenhada, essa abordagem pode apoiar práticas formativas (correção durante o treino, identificação de lacunas, trilhas personalizadas) e também reduzir carga de trabalho em tarefas repetitivas, liberando tempo docente para orientação e validação pedagógica.

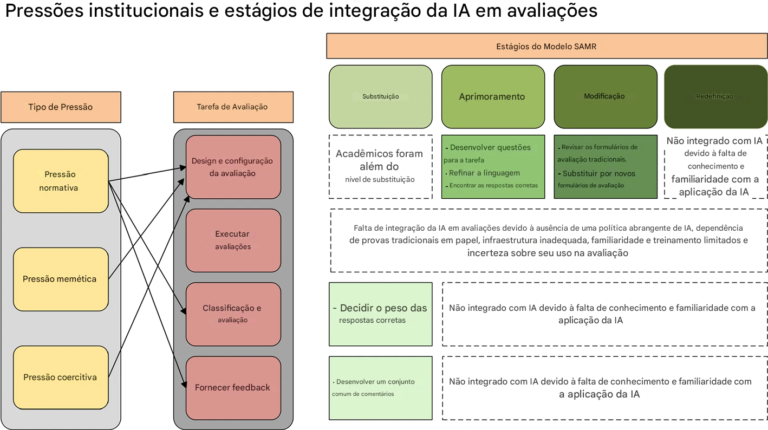

INSIGHT CENTRAL: Um dos pontos conceituais mais relevantes do estudo é a separação entre o que já tem evidência empírica (simulações, laboratórios virtuais, visão computacional, learning analytics) e as “extensões” ainda mais especulativas ligadas à IA generativa. Em vez de tratar “IA na avaliação” como um bloco único, a revisão argumenta por precisão: tecnologias diferentes servem a funções avaliativas diferentes, o que ajuda a explicar por que os resultados variam e por que políticas e decisões institucionais precisam ser específicas (por exemplo, avaliar técnica de soldagem em simulador não é o mesmo que avaliar comunicação, colaboração ou reflexões escritas com apoio de chatbots).

SIM, MAS…: A própria síntese aponta fragilidades do campo. Muitos estudos são pilotos com amostras pequenas (tipicamente entre 12 e 45 participantes), em uma única instituição, com medidas de resultado diversas, de desempenho técnico a engajamento, usabilidade e percepção de justiça, o que dificulta comparações e pode inflar conclusões quando “aprendizagem” vira um rótulo amplo. O contraste regional também pede cautela: diferenças de desenho, rigor, indicadores e contexto (como maturidade dos estudantes e experiência prévia de trabalho em sistemas de aprendizagem dual) podem influenciar resultados tanto quanto a tecnologia em si.

CONTEXTO E BASTIDORES: A revisão observa uma diferença de ênfase entre regiões: trabalhos chineses tendem a priorizar implantação e alinhamento com políticas e padrões nacionais de qualificação, enquanto estudos europeus e norte-americanos frequentemente destacam prototipagem e precisão algorítmica em condições mais controladas. Esse pano de fundo importa para gestores porque sugere que impacto educacional pode depender menos de “sofisticação do modelo” e mais do encaixe institucional: integração com currículo, infraestrutura para captura de dados (sensores, vídeo, logs), formação docente e critérios de avaliação alinhados a padrões ocupacionais.

O QUE VEM DEPOIS: Como contribuição aplicada, o artigo propõe um framework conceitual de avaliação de habilidades apoiada por IA, organizado em captura de dados, análise por IA, geração de avaliação/feedback e supervisão humana, destacando também módulos desejáveis como explicabilidade (XAI) e suporte multilíngue. O próximo passo implícito é transformar esse “baseline” em evidência mais forte: estudos multi-institucionais, com definições mais claras de construtos de habilidade, maior transparência de métricas e desenhos que permitam separar o efeito da tecnologia do efeito da implementação, uma agenda especialmente crítica se a IA generativa passar a mediar feedback e decisões avaliativas em escala.

Fonte: AI-Enhanced Skill Assessment in Higher Vocational Education: A Systematic Review and Meta-Analysis