Um estudo de caso em uma das principais faculdades de administração do Sri Lanka analisou como docentes estão redesenhando avaliações e incorporando ferramentas de IA, com destaque para o ChatGPT, em um contexto de adoção ainda inicial. A pesquisa mostra avanços sobretudo na fase de desenho de provas e trabalhos, mas também evidencia limites institucionais, infraestrutura desigual e ausência de políticas claras para que a transformação chegue à execução de exames, à correção em escala e ao feedback sistemático.

O QUE HÁ DE NOVO: A pesquisa “Changing assessment landscape in management education with AI-driven technologies: impacts and drivers” investiga, em um país em desenvolvimento, como tecnologias de IA estão alterando modelos de avaliação no ensino superior em gestão e quais forças empurram essa adoção. O trabalho foca a Faculdade de Estudos de Gestão e Comércio da University of Sri Jayewardenepura, com entrevistas semiestruturadas realizadas entre abril e junho de 2024 com nove docentes usuários de ChatGPT (totalizando 15 entrevistas em duas rodadas) e análise de documentos institucionais, como planos de curso e atas de reuniões acadêmicas.

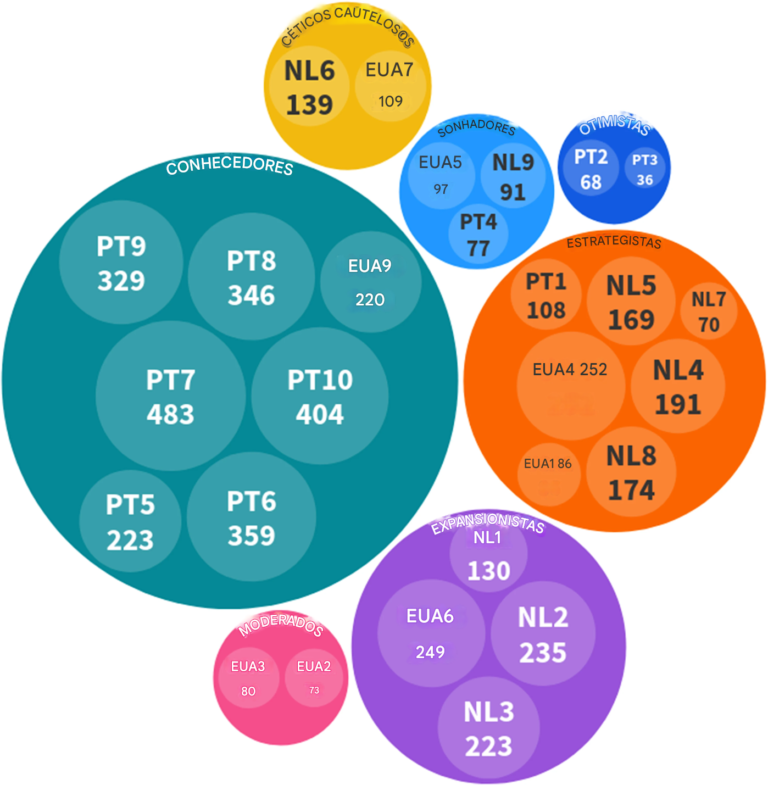

COMO FUNCIONA: Para mapear impactos e motivadores, os autores combinam dois referenciais: o modelo SAMR (Substituição, Aumento, Modificação e Redefinição), usado para classificar o grau de transformação pedagógica provocado pela tecnologia, e a teoria institucional (pressões coercitivas, miméticas e normativas), aplicada para explicar por que docentes e organizações passam a adotar IA em avaliações. A análise se concentra em quatro etapas do ciclo avaliativo, desenho e configuração, execução, correção/avaliação e feedback, e descreve usos concretos, como geração e refinamento de enunciados, testes de respostas e criação de comentários-padrão para devolutivas em atividades submetidas via LMS.

PRINCIPAIS RESULTADOS: O uso mais frequente de IA aparece no desenho e na configuração das avaliações: docentes recorrem ao ChatGPT para redigir ou sofisticar questões, criar itens de múltipla escolha e ajustar linguagem e clareza, um ponto relevante em um contexto em que o inglês não é a primeira língua de parte do corpo docente. Ao mesmo tempo, o estudo relata uma mudança de formatos para reduzir a vulnerabilidade a textos gerados por IA: substituição de relatórios por apresentações, pôsteres, resumos comentados com exposição oral, debates, vídeos explicativos e até atividades como mapas mentais, além de estratégias como seleção aleatória de apresentadores e checagens de compreensão para garantir autoria e domínio do conteúdo.

POR QUE ISSO IMPORTA PARA A EDUCAÇÃO: Para a sala de aula, os achados sugerem uma transição da avaliação centrada em produto escrito para formatos que exigem argumentação, oralidade, validação de fontes e tomada de decisão em tempo real, competências valorizadas em cursos de gestão e menos “terceirizáveis” para um gerador de texto. Para o trabalho docente, a IA entra como acelerador de tarefas de preparação (rascunhos de questões, revisão linguística, ideias de estrutura), mas não elimina a necessidade de julgamento pedagógico: os próprios entrevistados relatam revisar, corrigir e contextualizar o que a ferramenta produz, além de resistirem a usá-la para moderação de questões por preocupações de confiabilidade e por entenderem que o processo depende do conhecimento do contexto e do perfil dos estudantes.

SIM, MAS…: O estudo aponta um gargalo decisivo: não foram encontrados exemplos de uso de IA na execução de avaliações, em parte porque provas finais seguem majoritariamente presenciais e sem internet, e em parte por incerteza sobre permissões e falta de diretrizes institucionais. Em correção e avaliação, a adoção também é baixa, com usos pontuais como apoiar a construção de rubricas e a atribuição de pesos, mas sem automação ampla; no feedback, o uso aparece mais como “padronização” de comentários gerados por IA para tarefas no LMS, o que pode elevar detalhamento, mas também corre o risco de uniformizar devolutivas em excesso se não houver personalização. Esses limites conectam-se a obstáculos típicos de países em desenvolvimento descritos na própria fonte: infraestrutura digital insuficiente, investimento restrito e lacunas de formação para uso de IA em processos avaliativos.

CONTEXTO E BASTIDORES: Ao escolher o Sri Lanka, o estudo se posiciona como contraponto a boa parte da literatura concentrada em países com infraestrutura e governança de IA mais maduras. O pano de fundo inclui uma estratégia nacional (“AI Sri Lanka 2028”) e iniciativas recentes de alfabetização em IA, criação de programas universitários e acordos para introduzir IA em escolas, mas também uma trajetória marcada por crises econômicas e por uma digitalização “por necessidade” durante a pandemia, quando exames remotos reproduziram rotinas do papel em formato online, sem necessariamente gerar um redesenho estrutural das políticas de avaliação.

INSIGHT CENTRAL: A principal contribuição do trabalho é mostrar que a “mudança do jogo” na avaliação não é apenas tecnológica: ela é institucional. O que move docentes a usar IA não é só a promessa de eficiência, mas um conjunto de pressões. A normativa aparece como motor dominante (expectativas de qualidade, precisão linguística e padrões profissionais, inclusive ligados a exigências de órgãos externos de acreditação e isenções), a mimética surge como autodidatismo e observação do que pares internacionais fazem, e a coercitiva se expressa na necessidade de responder a preocupações com cola, plágio e legitimidade da avaliação, pressionando a reconfiguração de tarefas, mesmo quando a instituição ainda não oferece políticas claras para o uso responsável de IA.

O QUE VEM DEPOIS: A leitura dos autores sugere que a adoção, no caso observado, se concentra nos níveis de substituição e aumento do SAMR (e, em alguns casos, chega à modificação quando formatos são redesenhados), mas não alcança a redefinição, aquela em que a tecnologia possibilita avaliações inéditas, como simulações adaptativas e atividades em tempo real para medir pensamento de ordem superior. Para gestores e coordenadores, a implicação prática é que ampliar o uso com segurança tende a exigir três frentes: regras e orientações para o que é permitido em avaliações, infraestrutura para avaliações digitais quando fizer sentido e desenvolvimento profissional para que docentes usem IA além do “pré-trabalho” de elaboração, sem comprometer validade, confiabilidade e equidade.