Um estudo com calouros de pedagogia na China testou um sistema de feedback de IA generativa integrado a grafos de conhecimento em um curso e analisou como diferentes níveis de autoeficácia em IA afetam avaliação de tarefas, consciência de pensamento crítico, carga cognitiva e adoção do feedback. Os resultados apontam que a confiança do aluno para operar e julgar ferramentas de IA é parte central do desempenho e do uso produtivo do feedback, mesmo quando a GenAI é “ancorada” em conhecimento estruturado.

O QUE HÁ DE NOVO: A pesquisa investigou, em um programa de aprendizagem de sete semanas, como estudantes universitários com níveis distintos de AI self-efficacy (AISE), crença na própria capacidade de compreender e usar IA, se comportam ao receber feedback de uma GenAI conectada a um grafo de conhecimento (KG). O estudo envolveu 98 alunos do primeiro ano de Early Childhood Education em uma universidade chinesa (amostra final após exclusões), e comparou indicadores como autoavaliação e avaliação do professor, além de medidas ligadas à adoção do feedback e à experiência cognitiva durante as atividades.

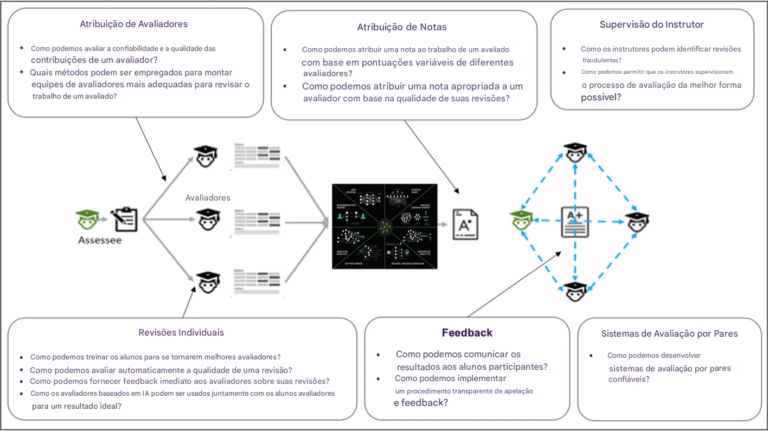

COMO FUNCIONA: Os autores desenvolveram um sistema KG-GenAI que combina um modelo de linguagem com fontes estruturadas: um grafo de conhecimento do domínio do curso “Preschool Health and Hygiene” e mecanismos de busca por similaridade via embeddings. O modelo base citado é o DeepSeek v3, ajustado (fine-tuned) com conhecimento do conteúdo da disciplina; a ideia é que o feedback gerado não dependa apenas de probabilidades do LLM, mas recupere e conecte conceitos, relações e “pontos de conhecimento” já estruturados no KG, o que tende a tornar explicações e recomendações mais rastreáveis e coerentes para o estudante.

PRINCIPAIS RESULTADOS: Em medidas de desempenho por tarefa, os resultados reportados no recorte disponível indicam ausência de diferenças estatisticamente significativas entre grupos de AISE para pelo menos uma das tarefas na autoavaliação (por exemplo, no primeiro trabalho, sem diferenças na avaliação inicial e também sem diferença significativa na avaliação após revisão). Já na discussão, os autores sustentam que a AISE aparece como fator relevante ao influenciar como os estudantes usam a informação gerada, com análises adicionais recorrendo a técnicas como Epistemic Network Analysis (ENA) e análise de conteúdo para descrever padrões de adoção do feedback e percepções sobre forças e limitações do agente KG-GenAI.

POR QUE ISSO IMPORTA PARA A EDUCAÇÃO: Para o ensino superior, a mensagem prática é que “melhorar o feedback” não é só uma questão de trocar o professor por um modelo de IA, ou mesmo de “corrigir” a GenAI com uma camada de conhecimento estruturado. A utilidade do feedback depende do engajamento ativo do aluno: interpretar, confrontar, revisar e decidir o que incorporar. Ao conectar esse processo à autoeficácia em IA, o estudo reforça que instituições que pretendem escalar GenAI em atividades avaliativas precisam planejar também intervenções de letramento e uso crítico, sob risco de ampliar diferenças entre quem já domina a ferramenta e quem se perde no fluxo de sugestões.

Do lado docente e de desenho instrucional, a integração com grafos de conhecimento aponta um caminho para tornar o feedback mais explicável e alinhado ao currículo, algo particularmente relevante quando as saídas do modelo não são revisadas por especialistas e podem conter erros ou “alucinações”. Em teoria, ancorar respostas em uma estrutura semântica do curso ajuda a reduzir ruído e a apoiar processos reflexivos, mas o estudo sugere que a capacidade do estudante de operar e julgar a IA continua sendo determinante para transformar sugestões em aprendizagem.

SIM, MAS…: O próprio enquadramento do trabalho reconhece fragilidades típicas do feedback por GenAI: possibilidade de desinformação, erosão de confiança e efeitos limitados quando o estudante não interage de forma ativa com os prompts reflexivos. Além disso, a evidência vem de um contexto específico, uma disciplina, um curso e um perfil de estudantes (majoritariamente mulheres, o que reflete a área), o que demanda cautela ao generalizar para outras áreas do conhecimento, outros níveis de exigência acadêmica ou instituições com diferentes condições de acesso e suporte.

Há também um alerta de implementação: se a adoção do feedback varia com AISE, políticas institucionais que liberam GenAI sem acompanhamento podem produzir ganhos assimétricos. Em ambientes com pouca infraestrutura, pouca formação docente para desenhar tarefas e baixa orientação ao estudante, o risco é que a ferramenta aumente carga cognitiva, gere confusão e reduza a qualidade da revisão, justamente o oposto do objetivo de oferecer feedback “oportuno e acionável”.

O QUE VEM DEPOIS: O trabalho aponta para uma agenda de pesquisa e desenvolvimento mais “personalizada”: sistemas que adaptem o tipo de feedback, o grau de orientação e as salvaguardas (por exemplo, explicações ancoradas no KG, checagens e perguntas de verificação) ao nível de AISE do estudante. Para gestores e coordenadores, isso se traduz em próximos passos como pilotos com diferentes disciplinas e desenhos de avaliação, acompanhamento longitudinal para verificar efeitos de longo prazo e, principalmente, estratégias explícitas para construir competências de uso crítico de IA como parte da formação universitária.

Fonte: AI self-efficacy and knowledge graph-integrated generative AI feedback in higher education