Uma revisão de escopo com 79 estudos e um estudo de caso da plataforma RiPPLE indicam que técnicas de IA, de modelos de linguagem a algoritmos de consenso e detecção de vieses, tendem a elevar a consistência e a utilidade da avaliação por pares no ensino superior, mas também revelam lacunas importantes em áreas como atribuição automática de avaliadores, calibração e feedback automatizado.

O QUE HÁ DE NOVO: O artigo “Enhancing peer assessment with artificial intelligence” propõe um framework com seis frentes de aplicação de IA em avaliação por pares e o utiliza para organizar uma revisão rápida de literatura e analisar um caso real. A revisão filtrou 6.930 resultados iniciais no Google Scholar até chegar a 79 trabalhos empíricos (publicados em inglês nos últimos 10 anos e com dados quantitativos e/ou qualitativos) focados em ensino superior. No recorte, a maior concentração de pesquisas está em “derivar notas/feedback a partir de avaliações de pares” (35 estudos) e em “analisar o feedback dos estudantes” (19), enquanto “atribuir avaliadores”, “supervisão docente” e “calibração/treinamento” aparecem com menos frequência, sinalizando um campo em expansão, mas ainda desigual em maturidade e cobertura.

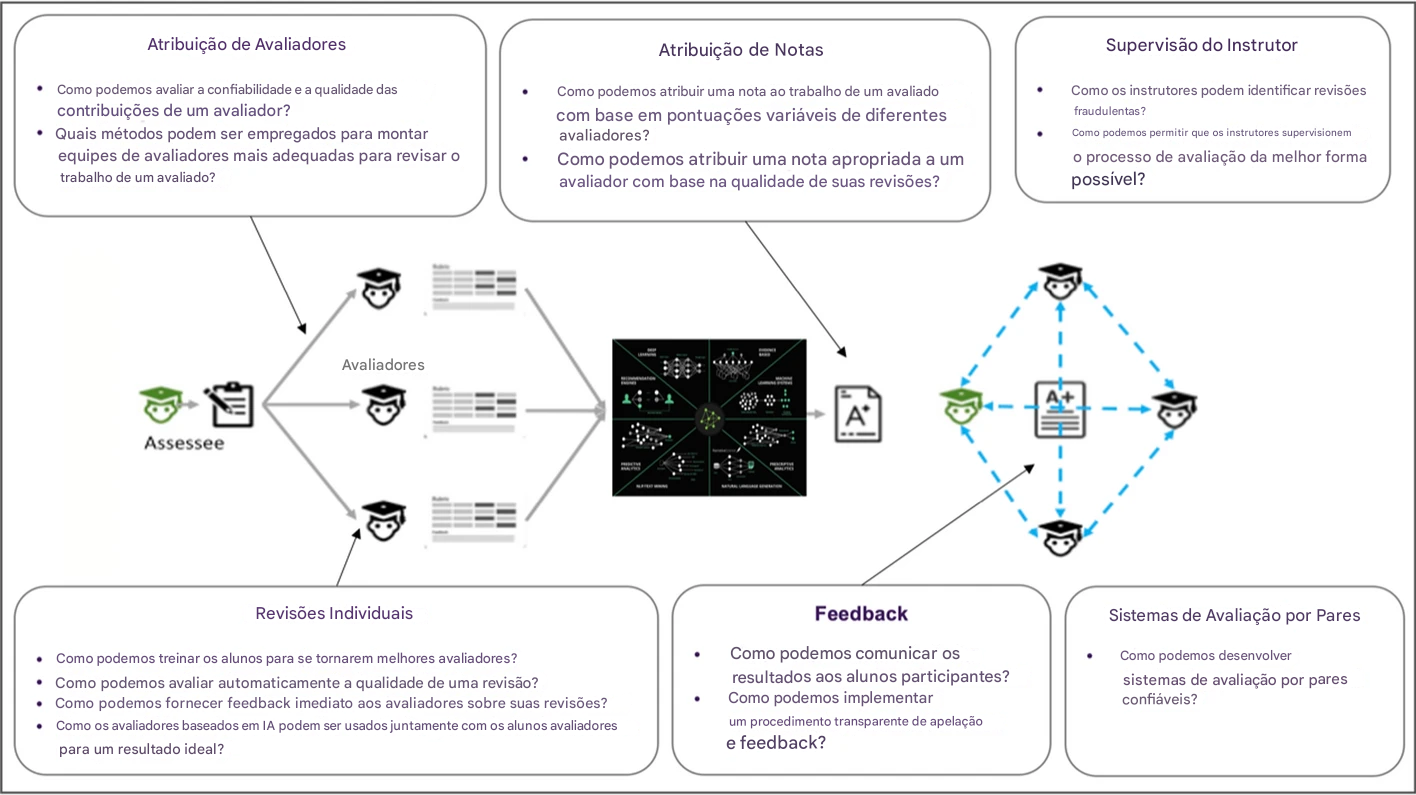

COMO FUNCIONA: O framework descreve onde a IA pode atuar ao longo do processo: (1) atribuição de pares avaliadores (por exemplo, usando histórico, expertise, rede social e confiabilidade para alocar revisores), (2) melhoria das revisões individuais (apoio à escrita de feedback e checagem de qualidade), (3) agregação de notas e comentários (modelos que ponderam vieses e precisão de revisores), (4) análise e síntese do feedback recebido (resumos e identificação de padrões como sugestões, críticas e afetividade), (5) supervisão do professor (dashboards, detecção de desvios e alertas) e (6) desenho de sistemas de avaliação por pares em escala. Na prática, os estudos revisados recorrem a técnicas como NLP para classificar e avaliar comentários, modelos probabilísticos para estimar viés e precisão, mecanismos de reputação para reduzir “rogue reviews” e, em alguns casos, lógica fuzzy para lidar com imprecisão linguística em rubricas e julgamentos.

POR QUE ISSO IMPORTA PARA A EDUCAÇÃO: Para o ensino superior, o achado central é que a IA tem sido usada sobretudo como “infraestrutura de confiabilidade” da avaliação por pares: ela ajuda a reduzir variações extremas, melhorar a consistência entre avaliadores e tornar o feedback mais acionável, um ponto crítico em turmas grandes, onde a correção docente integral é difícil. Do ponto de vista do trabalho do professor, há potencial de aliviar carga de correção e de monitorar qualidade com mais precisão, por exemplo sinalizando avaliações enviesadas, inconsistentes ou suspeitas, e priorizando o que deve ser revisado manualmente. Ao mesmo tempo, a revisão sugere que muitos ganhos relatados ainda se concentram em mecanismos de agregação e análise posterior, enquanto a promessa pedagógica mais ambiciosa, formar estudantes para serem bons avaliadores (calibração), gerar feedback realmente formativo em tempo real e desenhar alocações “justas” de avaliadores, permanece subexplorada, o que limita impactos mais profundos sobre aprendizagem e equidade.

PRINCIPAIS RESULTADOS: Na revisão, a maioria dos 79 estudos reporta melhorias na avaliação por pares com uso de IA, mas com forte concentração em tópicos como diversidade de notas/feedback, modelos de decisão e análise de comentários para elevar a qualidade média das devolutivas. Em contraste, poucas pesquisas abordam atribuição inteligente de avaliadores (4 estudos), supervisão docente automatizada (4) e feedback automatizado de fato (apenas 3), além de haver sinais de que algumas abordagens enfrentam trade-offs relevantes: mecanismos de “peer prediction” podem falhar em integridade de medição e, quando performam melhor, podem ficar vulneráveis a comportamento estratégico. Em contextos massivos (MOOCs), estudos com dezenas de milhares de notas mostram que modelar viés e confiabilidade de avaliadores pode aumentar a acurácia da nota final, e intervenções simples como tornar explícitos vieses de correção podem melhorar a qualidade das avaliações.

EXEMPLOS NA PRÁTICA EDUCACIONAL: O estudo de caso da plataforma RiPPLE ilustra um desenho em que avaliação por pares e recomendação de estudo se retroalimentam: estudantes criam recursos (como questões, flashcards e exemplos resolvidos), outros estudantes avaliam com rubricas, e um motor adaptativo recomenda prática personalizada com base no domínio por tópico. A IA entra em múltiplos pontos: há um mecanismo de “spot-checking” para priorizar itens com alta variância ou sinalização de problema para revisão do professor; um esquema de alocação que busca garantir ao menos um revisor considerado confiável; e um componente de IA generativa que oferece sugestões imediatas para melhorar o texto do feedback, com aviso explícito de que pode errar e de que o estudante deve julgar a qualidade da orientação recebida.

SIM, MAS…: O panorama também expõe riscos de implementação e pesquisa. Primeiro, há o risco de “autoridade indevida” da IA sobre estudantes iniciantes: mesmo com alertas sobre possíveis alucinações, feedback generativo pode induzir padronização superficial ou reforçar interpretações equivocadas se o desenho pedagógico não exigir reflexão e checagem. Segundo, mecanismos de agregação e reputação podem criar efeitos distributivos: se a “confiabilidade” de revisores for inferida por histórico, estudantes com menos experiência podem ter menor peso de influência, o que pede transparência e estratégias para desenvolvimento, não só filtragem. Terceiro, como grande parte da evidência é contextual (disciplinas, plataformas e formatos específicos), permanece a dúvida sobre generalização para diferentes áreas, culturas avaliativas e objetivos (formativo versus somativo).

O QUE VEM DEPOIS: O artigo aponta como agenda promissora ampliar estudos em áreas ainda pouco investigadas, especialmente atribuição automática de avaliadores, calibração/treinamento e feedback automatizado realmente formativo, e testar intervenções que combinem escalabilidade com desenvolvimento de julgamento avaliativo dos estudantes. Para gestores e coordenadores, o recado é que “IA para peer assessment” não se resume a automatizar notas: o valor tende a aparecer quando sistemas integram rubricas, mecanismos de qualidade, supervisão docente e orientação ao estudante, com salvaguardas explícitas contra vieses, comportamento estratégico e confiança excessiva em sugestões geradas por modelos.

Fonte: Enhancing peer assessment with artificial intelligence