Pesquisa com 664 estudantes e docentes da Universidade de Córdoba, na Colômbia, mostra que a IA generativa já faz parte do cotidiano acadêmico, mas evidencia lacunas importantes em ética, privacidade e políticas institucionais, apontando a urgência de capacitação e de diretrizes claras para seu uso responsável no ensino superior.

O QUE HÁ DE NOVO: O estudo, publicado na revista Ingeniería y Competitividad, analisou de forma comparativa como 576 estudantes de graduação e 88 docentes da Universidade de Córdoba percebem e utilizam ferramentas de IA generativa, como ChatGPT e Gemini. Aplicados entre março e maio de 2025, os questionários mediram frequência de uso, expectativas sobre o impacto futuro dessas tecnologias e percepção de riscos éticos e de privacidade. Os resultados indicam adoção ampla, mas desigual: mais de 90% dos alunos já interagiram com IA generativa, enquanto entre docentes o uso cresce de forma mais cautelosa, com cerca de 41% utilizando as ferramentas uma ou duas vezes por mês e 28% semanalmente para fins pedagógicos.

COMO FUNCIONA: A pesquisa utilizou questionários estruturados em escalas do tipo Likert, adaptados separadamente para professores (25 itens) e estudantes (19 itens). Os instrumentos, validados por especialistas e testados em pilotos, cobriram quatro eixos: dados sociodemográficos; uso de ferramentas de IA generativa; percepção de riscos éticos e de privacidade; e visão sobre o impacto futuro da tecnologia na educação e na pesquisa. A amostra foi definida por amostragem estratificada, considerando diferentes cursos e anos acadêmicos, com nível de confiança de 95%. As análises estatísticas, incluindo testes t, verificação de normalidade e testes não paramétricos complementares, permitiram identificar tendências consistentes nas respostas, comparando-as com um ponto neutro da escala. A equipe também interpretou qualitativamente padrões de concordância e divergência entre estudantes e docentes para desenhar recomendações institucionais.

PRINCIPAIS RESULTADOS: Entre os professores, predominou uma visão favorável, porém prudente, da IA generativa. Eles avaliaram como alta a utilidade dessas ferramentas para criar atividades inovadoras, personalizar o ensino e apoiar a escrita científica, e relataram conforto crescente em integrá-las ao planejamento e à avaliação. Ao mesmo tempo, expressaram forte preocupação com vieses, erros e impactos na pesquisa, além de riscos de uso inadequado por parte dos estudantes. Chamou a atenção a percepção de que violações de privacidade e problemas com dados não são raros, o que reforça a demanda por normas internas. Já quanto ao futuro, muitos docentes acreditam que a IA substituirá funções tradicionais, como parte da correção de provas e a elaboração de materiais, mas veem com mais cautela a ideia de uma transformação profunda das metodologias de ensino.

Entre os estudantes, o cenário é de familiaridade alta e uso frequente, embora predominantemente fora de arranjos pedagógicos estruturados. A maioria conhece e utiliza chatbots e outras ferramentas generativas para apoiar estudos, produzir textos, esclarecer dúvidas e organizar projetos, mas o emprego formal em disciplinas ainda é limitado. Os alunos demonstraram consciência moderada sobre riscos éticos e desinformação, ao reconhecerem que a IA pode tanto acelerar o trabalho quanto gerar respostas enganosas. Ao mesmo tempo, muitos declararam não perceber grandes problemas de privacidade, o que sugere subestimação de como seus dados são coletados e processados. Em relação ao futuro, prevaleceu um otimismo cauteloso: a IA é vista como competência profissional chave e como tecnologia que transformará carreiras e cursos, mas os estudantes julgam indispensáveis formações específicas e regras claras para equilibrar benefícios e riscos.

POR QUE ISSO IMPORTA PARA A EDUCAÇÃO: Os achados evidenciam um descompasso crescente entre a velocidade com que a IA generativa entra na rotina de estudo e trabalho e a capacidade institucional de orientar seu uso pedagógico. Na sala de aula, estudantes já usam intensamente essas ferramentas para escrever, revisar e buscar referências, enquanto muitos professores ainda experimentam de forma pontual e sem apoio sistemático. Isso cria um risco de assimetria: alunos avançam por conta própria, guiados por tutoriais e redes sociais, enquanto docentes e normas institucionais correm atrás para redefinir o que é autoria, originalidade e avaliação justa. Ao mesmo tempo, a percepção fragmentada sobre ética e privacidade pode comprometer tanto a integridade acadêmica quanto a proteção de dados sensíveis.

Do ponto de vista da gestão universitária e das políticas internas, o estudo sugere que não basta proibir ou liberar genericamente a IA generativa. A pesquisa aponta demandas concretas por formação continuada, currículos que incorporem letramento em IA e códigos de conduta que esclareçam quando e como essas ferramentas podem ser usadas em tarefas, pesquisas e avaliações. Sem esse arcabouço, aumentam os riscos de decisões ad hoc por curso ou docente, de desigualdades entre estudantes com maior ou menor acesso a tecnologia e de conflitos em torno de plágio e originalidade. Para sistemas de ensino de países latino-americanos, com forte heterogeneidade de infraestrutura, o caso colombiano funciona como alerta e como base empírica para pensar diretrizes regionais que aliem inovação, ética e equidade.

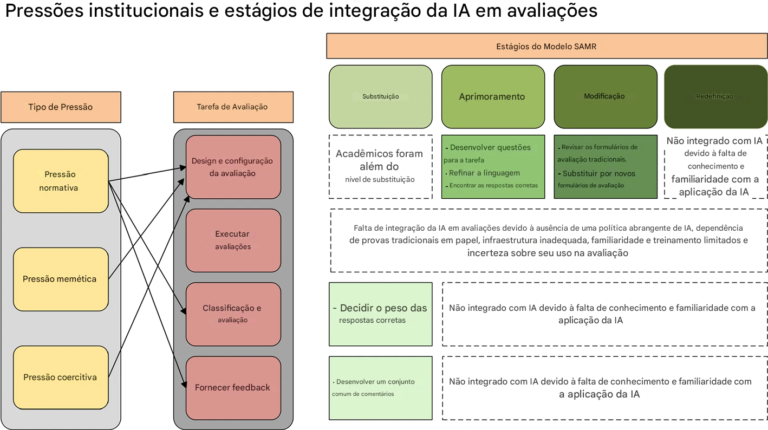

INSIGHT CENTRAL: Um dos aportes mais relevantes do estudo é mostrar que o debate sobre IA generativa em universidades não pode ser reduzido a uma disputa entre proibição e entusiasmo tecnológico. Ao comparar, na mesma instituição, percepções de docentes e estudantes, os autores revelam que a questão central é de governança pedagógica: como deslocar a IA do uso individual, improvisado e muitas vezes invisível, para um uso institucionalmente mediado, transparente e alinhado a objetivos formativos. Isso implica pensar a IA como suporte ao trabalho intelectual, e não como atalho para tarefas avaliativas, desenhando atividades em que o uso de ferramentas seja explicitado, discutido e criticamente analisado. Essa virada, da IA como “cola sofisticada” para IA como objeto e meio de aprendizagem, é o elemento que diferencia este estudo de diagnósticos mais genéricos.

SIM, MAS… (limitações e riscos): Os próprios autores reconhecem que, embora a amostra seja estatisticamente robusta para uma universidade, o estudo se concentra em uma única instituição colombiana e em um recorte temporal específico. Isso limita a generalização para outros contextos, especialmente em países com marcos regulatórios distintos ou com infraestrutura tecnológica mais precária. Além disso, as evidências são essencialmente autorrelatadas, o que pode levar à subestimação de comportamentos problemáticos (como uso para plágio) e à supervalorização de atitudes éticas. Na implementação de políticas, há riscos adicionais: capacitações pontuais sem continuidade, normas muito restritivas que empurrem o uso da IA para a clandestinidade e investimentos em ferramentas que ampliem desigualdades entre cursos ou campi. Também persiste a incerteza sobre como avaliar, a médio prazo, o efeito da IA no desenvolvimento de pensamento crítico e autoria acadêmica.

O QUE VEM DEPOIS: Com base nos resultados, o artigo propõe um plano operacional de 12 meses para integrar a IA generativa de forma ética e pedagógica, estruturado em seis eixos que incluem formação docente, políticas participativas, revisão curricular e fortalecimento de infraestrutura. Para além desse horizonte, abrem-se linhas claras para pesquisa e política institucional: acompanhar longitudinalmente como o uso da IA afeta desempenho, engajamento e competências dos estudantes; testar modelos de avaliação que combinem produção assistida por IA com etapas de reflexão e defesa oral; comparar percepções em outras universidades latino-americanas; e articular as diretrizes internas a recomendações de organismos como UNESCO e OEI. A agenda que se desenha não é a de eliminar a IA da universidade, mas de aprender a conviver com ela de modo crítico, transparente e alinhado à missão formativa do ensino superior.

Fonte(s): A study on the perception of Generative AI in higher education students and teachers