Um estudo com universitários investigou como traços cognitivos, como disposição para pensar com esforço e capacidade de frear respostas intuitivas, influenciam o uso de IA generativa em tarefas de economia. Os dados indicam que estudantes mais reflexivos e com maior “need for cognition” tendem a depender menos de chatbots, enquanto a introdução de IA esteve associada a queda de desempenho em problemas estruturados, levantando alertas sobre “offloading” cognitivo e qualidade de prompts em sala de aula.

O QUE HÁ DE NOVO: Pesquisadores analisaram como estudantes não especialistas em IA recorreram a ferramentas como ChatGPT para resolver problemas econômicos e como isso se relacionou a variáveis psicológicas e de desempenho. O levantamento foi realizado entre maio e junho de 2023, com 487 respostas completas de alunos (principalmente de economia e psicologia), e buscou entender quem usa mais IA, em quais condições, e se isso melhora ou piora a resolução de tarefas quantitativas e financeiras.

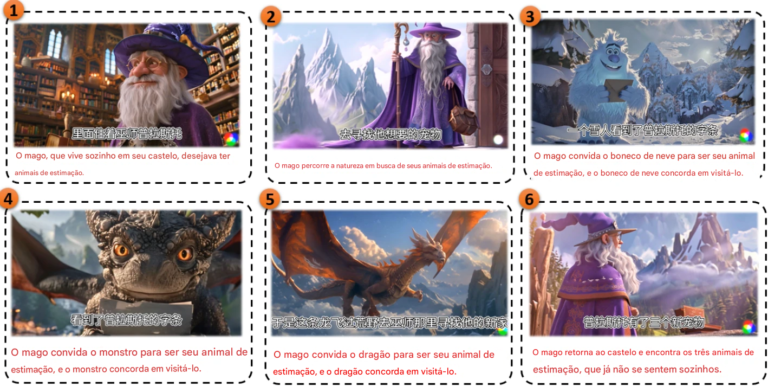

COMO FUNCIONA: Em uma sessão única, os participantes responderam escalas padronizadas de Need for cognition (18 itens) e um teste de Cognitive reflection (itens clássicos do CRT), e depois resolveram problemas de finanças/juros e pagamento parcelado, podendo usar livremente recursos como buscadores, planilhas, calculadora, papel e “ChatGPT ou similar”, desde que não colaborassem entre si. Ao final de cada questão, indicavam quais ferramentas utilizaram; o “uso de IA” foi operacionalizado pela contagem de vezes em que o aluno marcou o uso de chatbot (pontuação de 0 a 3, já que uma das questões acabou excluída por não ter sido concluída por ninguém). Para analisar relações diretas e indiretas entre os construtos, inclusive efeitos de mediação e moderação, o estudo aplicou modelagem de equações estruturais via PLS-SEM com bootstrapping.

PRINCIPAIS RESULTADOS: Os autores relatam que escores mais altos de Cognitive reflection e Need for cognition se associaram a melhor desempenho na resolução de problemas econômicos, reforçando a ideia de que pensar de forma deliberada e sustentar esforço mental ajuda em tarefas estruturadas. Ao mesmo tempo, a introdução de IA aparece ligada a uma redução de performance no conjunto das tarefas, e a interação “uso de IA × cognitive reflection” teria enfraquecido a relação positiva entre reflexão e desempenho, sinal de que, quando estudantes mais reflexivos recorrem ao chatbot, podem se beneficiar menos de sua própria análise ou avaliar de forma menos crítica as respostas geradas.

POR QUE ISSO IMPORTA PARA A EDUCAÇÃO: Para a sala de aula, o achado central tensiona uma suposição frequente: que dar acesso a IA generativa, por si só, eleva a qualidade do raciocínio e das respostas. Se a IA funcionar como atalho, parte dos estudantes pode “terceirizar” etapas de verificação, cálculo e interpretação, e isso tende a impactar não apenas o resultado imediato, mas também a aprendizagem, porque reduz o tempo em que o aluno pratica decomposição de problemas, conferência e autocorreção. Do ponto de vista do trabalho docente e da avaliação, os resultados reforçam a necessidade de desenhar tarefas que exijam justificativas, rastreabilidade do raciocínio e checagem de plausibilidade, além de orientar explicitamente como avaliar a confiabilidade de saídas do modelo e como construir prompts com contexto, restrições e etapas.

INSIGHT CENTRAL: O estudo sugere que o diferencial não está apenas em “usar ou não usar IA”, mas em como traços de motivação cognitiva e reflexão alteram a estratégia do estudante: quem gosta de desafios e tende a pensar devagar recorre menos ao chatbot e, quando recorre, pode sofrer mais com efeitos de confiança excessiva ou com a redução do próprio engajamento analítico. Isso desloca o foco da adoção tecnológica para a competência de interação, incluindo a capacidade de estruturar pedidos (prompts) e de auditar respostas, como parte do repertório de letramento em IA que instituições precisam desenvolver.

SIM, MAS…: Há limites importantes para a leitura desses achados como regra geral para “IA na educação”. A amostra vem de um contexto institucional específico (com participantes de economia e outras ciências sociais) e os dados dependem de autorrelato sobre ferramentas utilizadas, além de terem sido coletados em 2023, com versões anteriores de chatbots (os autores mencionam que não era o modelo mais recente). O próprio uso de listwise deletion para dados faltantes reduziu a amostra final e pode introduzir viés. Por fim, as tarefas são estruturadas e quantitativas; é plausível que, em atividades abertas (como redação, ideação ou projetos), a relação entre IA, criatividade e desempenho siga outro padrão.

O QUE VEM DEPOIS: Os autores apontam a necessidade de replicações em outros contextos culturais e com participantes com maior experiência em IA e “prompt engineering”, além de desenhos que reduzam dependência de autorrelato e capturem logs de interação (o que foi perguntado e como a resposta foi usada). Para gestores e formuladores de política acadêmica, uma implicação prática é que diretrizes de uso de IA devem ir além do “pode/não pode”: precisam especificar expectativas de verificação, transparência sobre o papel do chatbot e critérios de qualidade do processo, especialmente em disciplinas em que a aprendizagem depende de manter o desafio cognitivo, não de eliminá-lo.

Fonte: Do students need to think hard? The interplay of AI and cognitive abilities in solving problems