Um estudo de caso descreve o desenvolvimento e a implantação inicial de uma ferramenta educacional bilíngue (cazaque–russo) que usa IA generativa para transformar textos em perguntas alinhadas à Taxonomia de Bloom, com pontuação e feedback para avaliação formativa no ensino fundamental II. A iniciativa mira o fortalecimento do pensamento crítico em estudantes do ensino secundário e apresenta, além da arquitetura do sistema, evidências preliminares de qualidade das questões por revisão de especialistas e métricas iniciais de engajamento em um piloto com uma turma.

O QUE HÁ DE NOVO: Pesquisadores e desenvolvedores ligados à Satbayev University e à empresa Global Optima Technologies LLP relatam a criação de uma aplicação com IA voltada a apoiar professores na elaboração de atividades que promovam pensamento crítico. O sistema foi implantado em caráter inicial em um contexto escolar com uma turma 6A (n=18) e passou por uma revisão especializada de 30 itens gerados, avaliada por três docentes de literatura, enquanto a coleta de dados de linha de base ainda está em andamento para comparação futura do impacto na habilidade dos estudantes.

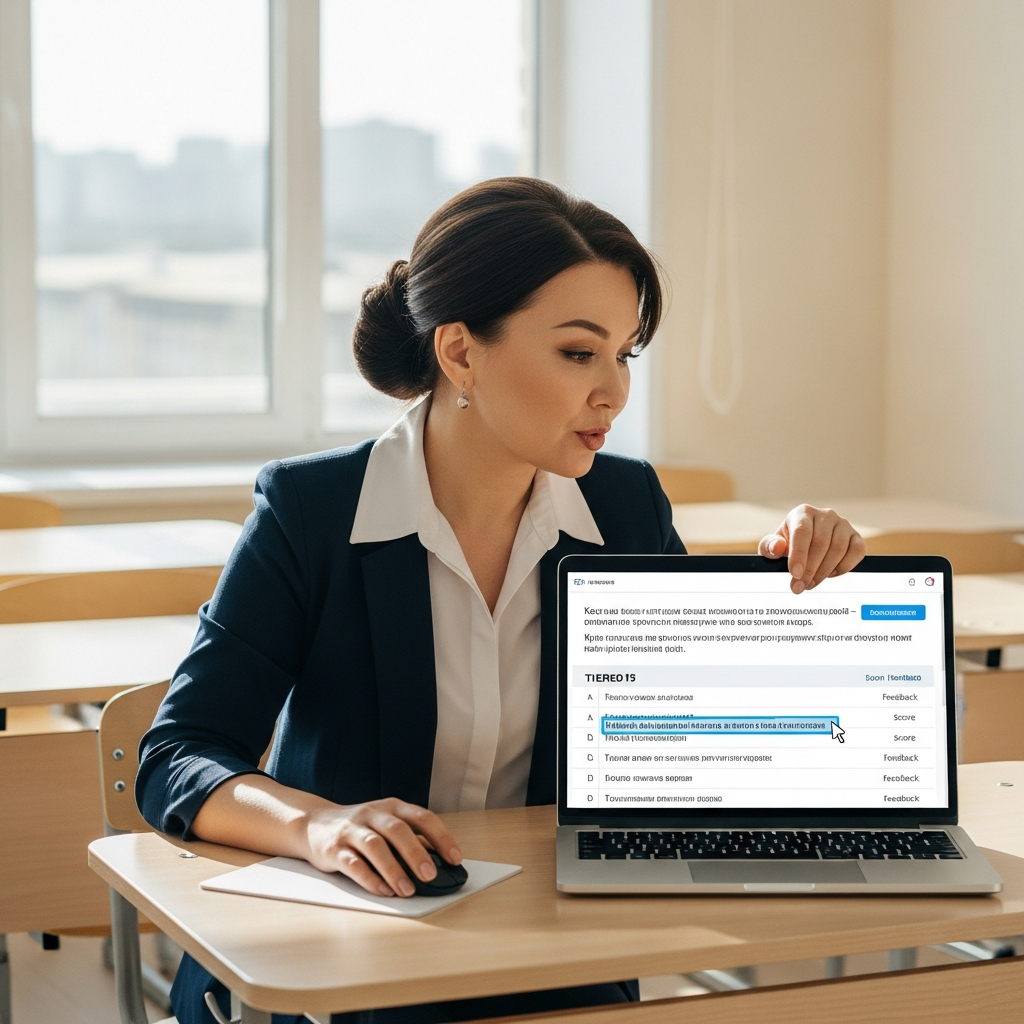

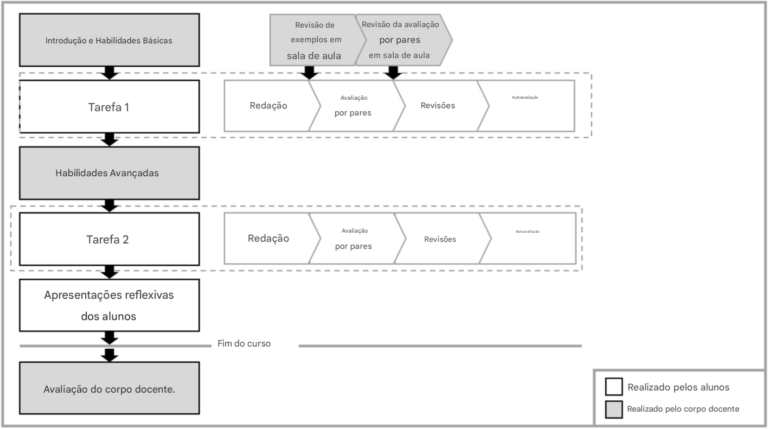

COMO FUNCIONA: O fluxo proposto coloca o professor no centro da curadoria: ele faz o upload de textos literários ou instrucionais e a ferramenta aplica processamento de linguagem natural e modelos de linguagem de grande porte para analisar o conteúdo e gerar automaticamente perguntas estruturadas por nível cognitivo, cobrindo desde recordação e compreensão até análise, avaliação e síntese criativa, de acordo com Bloom. A geração é descrita como orientada por prompts e apoiada por recuperação de informações (retrieval-augmented), e o sistema incorpora um mecanismo de pontuação e devolutivas para sustentar avaliação formativa e incentivar aprendizagem autorregulada, ao transformar as perguntas em atividades acompanhadas de feedback.

POR QUE ISSO IMPORTA PARA A EDUCAÇÃO: Em sala de aula, a promessa é reduzir uma barreira recorrente: o tempo e a expertise necessários para produzir perguntas de qualidade que realmente escalem a complexidade cognitiva, sobretudo em disciplinas baseadas em leitura. Ao automatizar a “primeira versão” de bancos de questões por níveis, a ferramenta pode ampliar a exposição dos estudantes a tarefas que demandem argumentação, julgamento e criação, aspectos frequentemente citados como essenciais para resolver problemas complexos e tomar decisões informadas.

Para o trabalho docente e a gestão pedagógica, o ganho potencial está em transformar textos já usados no currículo em instrumentos de diagnóstico e acompanhamento, com pontuação e feedback que apoiem intervenções rápidas. Em redes e escolas com diversidade linguística, o desenho bilíngue (cazaque–russo) sugere um caminho para adaptar materiais a contextos locais, algo relevante quando políticas e plataformas globais de IA tendem a privilegiar poucos idiomas e repertórios culturais.

PRINCIPAIS RESULTADOS: As evidências apresentadas nesta fase são iniciais e focadas em viabilidade e qualidade aparente: um painel de três professores de literatura revisou 30 questões geradas, e o estudo reporta métricas iniciais de engajamento no piloto com 18 estudantes. O trabalho, porém, ainda não traz uma comparação de ganhos de pensamento crítico, pois a linha de base está sendo coletada para permitir análises comparativas posteriores sobre o efeito do uso da ferramenta.

SIM, MAS…: Sem resultados de aprendizagem ainda quantificados, permanece a dúvida central para gestores: a geração automática de perguntas alinhadas a Bloom se traduz em melhoria mensurável de pensamento crítico, ou apenas em maior volume de exercícios? Além disso, a qualidade das perguntas pode variar com o tipo de texto, o desenho dos prompts e a capacidade do professor de revisar e contextualizar os itens, um ponto crítico em ambientes com pouco tempo de planejamento e formação limitada para uso pedagógico de IA.

Há também riscos típicos de aplicações baseadas em modelos de linguagem que precisam ser tratados na implementação escolar: possibilidade de perguntas imprecisas ou mal calibradas para a idade, vieses culturais no tratamento de textos e dependência excessiva do professor em relação ao gerador. Como a ferramenta opera a partir de upload de conteúdos, questões de privacidade e governança de dados (que textos são enviados, onde são processados, por quanto tempo ficam armazenados e com que finalidade) tornam-se parte do checklist mínimo para adoção responsável.

INSIGHT CENTRAL: O diferencial do projeto não está em “substituir” o professor, mas em padronizar e acelerar um artefato didático de alto impacto, a boa pergunta, conectando-o explicitamente a uma progressão cognitiva reconhecida (Bloom) e a um ciclo de avaliação formativa. Em vez de usar IA apenas para resumir textos ou responder dúvidas, o sistema tenta organizar a experiência de leitura em degraus de complexidade, o que pode favorecer práticas consistentes de ensino voltadas a análise, avaliação e criação.

O QUE VEM DEPOIS: O estudo aponta como próximos passos a análise comparativa, baseada na linha de base em coleta, para estimar o efeito no desenvolvimento do pensamento crítico e sustentar decisões de escala. Para avançar rumo a implementação mais ampla, o campo tende a demandar replicações em outras disciplinas, séries e perfis de escola, além de protocolos claros de revisão humana, critérios de qualidade das questões e indicadores de aprendizagem que ultrapassem engajamento e cheguem a evidências de mudança em desempenho e em práticas de argumentação.