Uma revisão de literatura publicada no IIS Scientific analisa, com base no protocolo PRISMA, como o uso crescente de inteligência artificial vem reorganizando a aprendizagem docente e a formação de professores entre 2015 e 2025. O estudo aponta ganhos em diagnóstico pedagógico e personalização do ensino, mas também alerta para efeitos colaterais como intensificação do controle sobre o trabalho docente, vieses e redução da educação a métricas, defendendo transparência algorítmica e políticas públicas inclusivas.

O QUE HÁ DE NOVO: O artigo “Algoritmos e experiência humana: redefinindo a aprendizagem docente na era da inteligência artificial”, de Renato Bonifácio dos Santos, sistematiza evidências e debates de publicações nacionais e internacionais da última década (2015–2025) para responder a uma questão prática para redes e instituições formadoras: quando algoritmos entram na sala de aula e na gestão pedagógica, o que muda na maneira como professores aprendem a ensinar? Ao reunir a produção recente sobre personalização, avaliação, autonomia docente, ética educacional e gestão, o trabalho busca transformar um debate fragmentado em um panorama útil para tomada de decisão.

COMO FUNCIONA: Trata-se de um estudo qualitativo de revisão de literatura estruturado pelo protocolo PRISMA, um padrão amplamente usado para organizar buscas, critérios e seleção de trabalhos em revisões. Em vez de testar uma ferramenta específica em escolas, o artigo reconstrói o “caminho” pelo qual a IA costuma chegar à prática docente: sistemas que analisam dados de aprendizagem para diagnóstico, plataformas que recomendam conteúdos e trajetórias, uso de IA na avaliação e no feedback, e aplicações que, direta ou indiretamente, influenciam planejamento e monitoramento pedagógico. A partir desse mapeamento, a análise discute como esses usos reconfiguram decisões do professor e deslocam parte da mediação pedagógica para modelos e métricas.

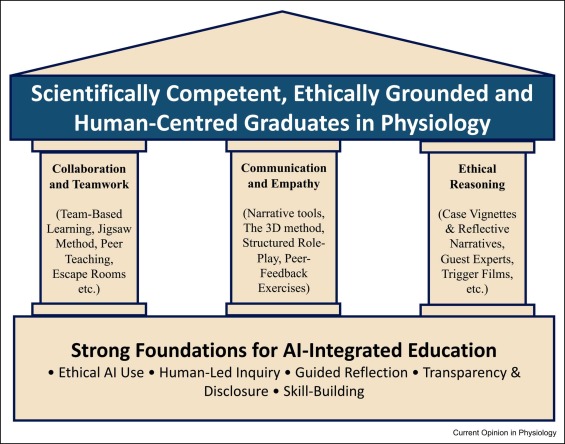

INSIGHT CENTRAL: O principal argumento do texto é que a aprendizagem docente na era algorítmica tende a se tornar uma prática “híbrida”: a tecnologia pode atuar como parceira estratégica para ampliar capacidade de análise e apoiar intervenções pedagógicas, mas a experiência humana deve permanecer como eixo organizador da educação. Na leitura do autor, esse equilíbrio não acontece por inércia: depende de desenho institucional (normas, formação, governança) para evitar que a IA, ao prometer eficiência, passe a definir o que conta como bom ensino apenas pelo que é mensurável.

PRINCIPAIS RESULTADOS: A revisão identifica oportunidades recorrentes associadas à IA na docência, com destaque para ganhos em diagnóstico pedagógico, isto é, a possibilidade de detectar padrões de desempenho e necessidades de aprendizagem com mais rapidez, e para o suporte à personalização e à experimentação metodológica. Em paralelo, os achados sintetizados sugerem riscos quando a adoção é acrítica: reforço de desigualdades (por exemplo, quando dados e infraestrutura variam muito entre escolas), aumento do controle gerencial sobre o trabalho docente via “gestão algorítmica” e uma tendência de reduzir processos educativos complexos a indicadores quantitativos, com impactos sobre autonomia e currículo vivido.

POR QUE ISSO IMPORTA PARA A EDUCAÇÃO: Para a sala de aula, o debate é menos sobre “usar ou não usar IA” e mais sobre que tipo de personalização se busca: sistemas podem ajudar a ajustar ritmo e oferecer feedback, mas também podem estreitar objetivos educacionais para o que é facilmente classificável e comparável. Para o trabalho do professor, a promessa de eficiência pode virar pressão: se algoritmos passam a orientar metas, sequências didáticas ou avaliações, a autonomia pedagógica pode ser substituída por conformidade com dashboards e regras opacas. No nível de gestão e políticas, o estudo reforça que decisões sobre transparência, proteção de dados e compras públicas podem ampliar ou mitigar assimetrias entre redes; sem governança, a IA pode institucionalizar vieses e desigualdades em escala.

SIM, MAS…: Por ser uma revisão de literatura, o artigo não oferece uma medida única de impacto (como melhora em notas ou redução de tempo de correção) nem isola causalidade, limitações típicas desse tipo de pesquisa, embora compensadas pela capacidade de mapear padrões e riscos. Além disso, o texto sugere que boa parte das tensões surge fora do “modelo” em si: políticas de dados, contratos com fornecedores, formação insuficiente e a falta de explicabilidade/clareza sobre como recomendações e classificações são geradas. Na prática, isso significa que a efetividade pedagógica e a integridade ética podem depender mais de governança do que de funcionalidades.

O QUE VEM DEPOIS: A revisão aponta como próximos passos a necessidade de políticas públicas inclusivas, maior transparência algorítmica e formação crítica de professores para que a IA seja incorporada de modo reflexivo. Para gestores e instituições formadoras, a implicação é imediata: preparar docentes não apenas para operar ferramentas, mas para avaliar limites, evidências, vieses e efeitos de controle e de padronização. O artigo também reforça uma agenda de pesquisa aplicada que compare modelos de adoção em diferentes contextos escolares e investigue impactos de longo prazo sobre autonomia docente, equidade e qualidade educacional.

Fonte: https://iiscientific.com/ojs/index.php/iis/en/article/view/228